Die AMD Radeon R9 285 verwendet einen Tonga-Grafikchip mit 1.792 Shader-Einheiten. Wie AMD später auch zugab, ist die GPU auf dieser Grafikkarte nicht komplett freigeschaltet. Gerüchte um eine Version mit den kompletten 2.048 Shadern und einem 384-Bit-Speicherinterface oder gar um eine Dual-GPU-Grafikkarte mit Tonga gab es zwar, doch die entsprechenden Modelle wurden nie auf den Markt gebracht. Stattdessen nutzte AMD den Tonga-Chip mit 2.048 Shadern dann als mobile Variante Radeon R9 M295 für Apple. Die Radeon R9 380X verwendet ebenfalls den Tonga-Grafikchip, allerdings nur mit 256-Bit-Speicherinterface.

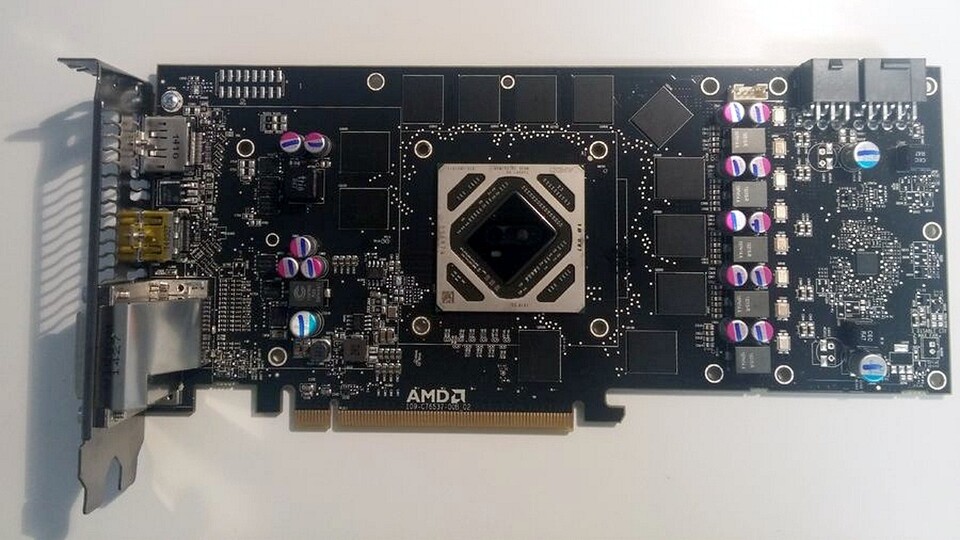

Doch die AMD Radeon R9 285X mit voll funktionsfähiger Tonga-GPU und 384-Bit-Speicherinterface war wohl mehr als nur ein Gerücht und stand anscheinend sogar wirklich kurz vor der Markteinführung. Der Nutzer ZealotKi11ler hat im Forum von Overclock.net einige Fotos und technische Daten dieser Grafikkarte veröffentlicht. Die Grafikkarte sieht zwar wie eine Radeon R9 280X aus, verwendet aber eine andere Platine und hat ein 384-Bit-Interface.

Die Radeon R9 285X war demnach mit 3 GByte GDDR5 ausgestattet, das effektive 5,5 GHZ schnell ist. Der Grafikchip läuft mit 1 GHz und damit 10 Prozent schneller als bei einer Radeon R9 285, aber 30 MHz langsamer auf einer Radeon R9 380X. Die ebenfalls veröffentlichten Benchmarks der Radeon R9 285X zeigen, dass die Grafikkarte deutlich schneller gewesen wäre als eine Radeon R9 285 und wohl auch minimal vor einer Radeon R9 380X gelegen wäre.

Ein Grund dafür, die Radeon R9 285X nie auf den Markt zu bringen, war vermutlich der Speicherausbau. Eine Radeon R9 285 hätte mit einem 384-Bit-Speicherinterface mit 3 oder 6 GByte erscheinen müssen, AMD war aber auf dem Weg zu Grafikkarten mit zu diesem Zeitpunkt sinnvollen 4 GByte und hatte daher das Speicherinterface auf 256 Bit beschränkt. So zumindest die Spekulation von Videocardz. Vermutlich wäre ein Modell mit 6 GByte VRAM zu diesem Zeitpunkt einfach zu teuer gewesen.

Quelle: Overlock.net, Videocardz

Nur angemeldete Benutzer können kommentieren und bewerten.

Dein Kommentar wurde nicht gespeichert. Dies kann folgende Ursachen haben:

1. Der Kommentar ist länger als 4000 Zeichen.

2. Du hast versucht, einen Kommentar innerhalb der 10-Sekunden-Schreibsperre zu senden.

3. Dein Kommentar wurde als Spam identifiziert. Bitte beachte unsere Richtlinien zum Erstellen von Kommentaren.

4. Du verfügst nicht über die nötigen Schreibrechte bzw. wurdest gebannt.

Bei Fragen oder Problemen nutze bitte das Kontakt-Formular.

Nur angemeldete Benutzer können kommentieren und bewerten.

Nur angemeldete Plus-Mitglieder können Plus-Inhalte kommentieren und bewerten.