Update: Welche Gefahren schon in Waffen stecken, die immer noch ein Mensch bedient, werden die beiden Hacker Runa Sandvik und Michael Auger auf der Black Hat 2015 präsentieren. Es ist ihnen gelungen, sogenannte »Smart Rifles« per WLAN zu manipulieren. Diese Gewehre sind mit einem kleinen Linux-basierten Rechner ausgestattet, der die automatische Zielerfassung steuert, über Sensoren auch Faktoren wie Wind, Neigung und Temperatur berücksichtigt. So sollen auch vollkommen unerfahrene Schützen stets das Ziel treffen. Außerdem können die Gewehre untereinander kommunizieren und so dafür sorgen, dass der Schütze mit dem besten Winkel das Ziel übernimmt.

Doch die WLAN-Verbindung dieser Gewehre ist schlecht abgesichert und nutzt entweder ein Standard-Passwort oder eine PIN. So erreichten die Hacker sogar einen Zugang mit Root-Rechten und konnten so Daten wie das Gewicht der Munition manipulieren. Das sorgte dafür, dass das Gewehr zu weit nach links oder rechts zielt. Damit könnten theoretisch Ziele anvisiert werden, die vom Schützen gar nicht gewünscht sind. Außerdem konnte das Gewehr unbrauchbar gemacht oder die Zielvorrichtung deaktiviert werden.

Bei diesen Smart Rifles muss noch ein Mensch den Abzug drücken, doch bei komplett autonomen Waffen, die sicher auch drahtlos kommunizieren dürften, soll eine KI aufgrund der vorhandenen Daten entscheiden und die Waffe auslösen. Doch wie der Hack der Smart Rifles zeigt, können manipulierte Daten unerwünschte Konsequenzen haben. »Wenn man Technik in Dinge einbaut, die zuvor keine enthielten, wird man mit Sicherheitsrisiken konfrontiert, an die man zuvor nicht gedacht hat«, so Sandvik.

Quelle: Wired

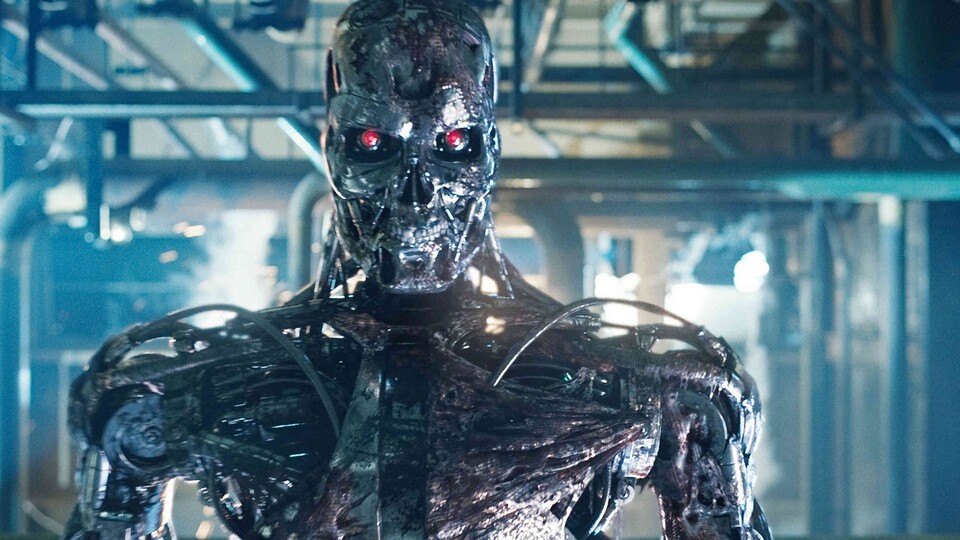

Originalmeldung: Seit vielen Monaten nimmt eine Diskussion über Künstliche Intelligenz Fahrt auf, bei der viele Technik-Experten und Wissenschaftler vor den möglichen Gefahren warnen. Sogar die Vereinten Nationen haben in Ausschüssen darüber diskutiert und denken darüber nach, bestimmte autonome Waffensysteme zu verbieten. In einem offenen Brief haben nun mehr als 1000 Technik-Experten, Wissenschaftler und Forscher zu einem Verbot von Waffen aufgerufen, die durch Künstliche Intelligenz und nicht mehr durch Menschen kontrolliert wird.

»So wie die meisten Chemiker und Biologen kein Interesse daran haben, chemische oder biologische Waffen zu bauen, haben die meisten KI-Forscher kein Interesse daran, KI-Waffen zu erschaffen und wollen auch nicht, dass andere ihr Forschungsgebiet auf diese Weise beflecken“, so der Brief. Die Technik im Bereich der Künstlichen Intelligenz habe einen Punkt erreicht, an dem es nicht mehr Jahrzehnte, sondern nur noch Jahre dauern wird, bis es möglich sei, vollkommen autonome Waffen zu erschaffen. „Die Kernfrage der Menschheit lautet heute, ob ein weltweites KI-Wettrüsten gestartet oder verhindert werden soll. Sobald irgendeine größere Militärmacht die Entwicklung von KI-Waffen vorantreibt, wird ein weltweites Wettrüsten kaum noch zu verhindern sein“.

Am Ende wären KI-Waffen die Kalaschnikows der Zukunft und es sei nur eine Frage der Zeit, bis es einen Schwarzmarkt gäbe, auf dem sich Terroristen und Diktatoren bedienen. „Wir glauben, dass ein militärisches KI-Wettrüsten für die Menschheit nicht von Vorteil wäre. Es gibt viele Möglichkeiten, wie KI dabei helfen kann, Schlachtfelder für Menschen und vor allem Zivilisten sicherer zu machen, ohne neue Werkzeuge für das Töten von Personen zu schaffen“. Zu den weltweit bekannten Unterzeichnern gehören unter anderem Stephen Hawking, Elon Musk, Steve Wozniak und Noam Chomsky.

Quelle: Future of Life Institute

Nur angemeldete Benutzer können kommentieren und bewerten.

Dein Kommentar wurde nicht gespeichert. Dies kann folgende Ursachen haben:

1. Der Kommentar ist länger als 4000 Zeichen.

2. Du hast versucht, einen Kommentar innerhalb der 10-Sekunden-Schreibsperre zu senden.

3. Dein Kommentar wurde als Spam identifiziert. Bitte beachte unsere Richtlinien zum Erstellen von Kommentaren.

4. Du verfügst nicht über die nötigen Schreibrechte bzw. wurdest gebannt.

Bei Fragen oder Problemen nutze bitte das Kontakt-Formular.

Nur angemeldete Benutzer können kommentieren und bewerten.

Nur angemeldete Plus-Mitglieder können Plus-Inhalte kommentieren und bewerten.