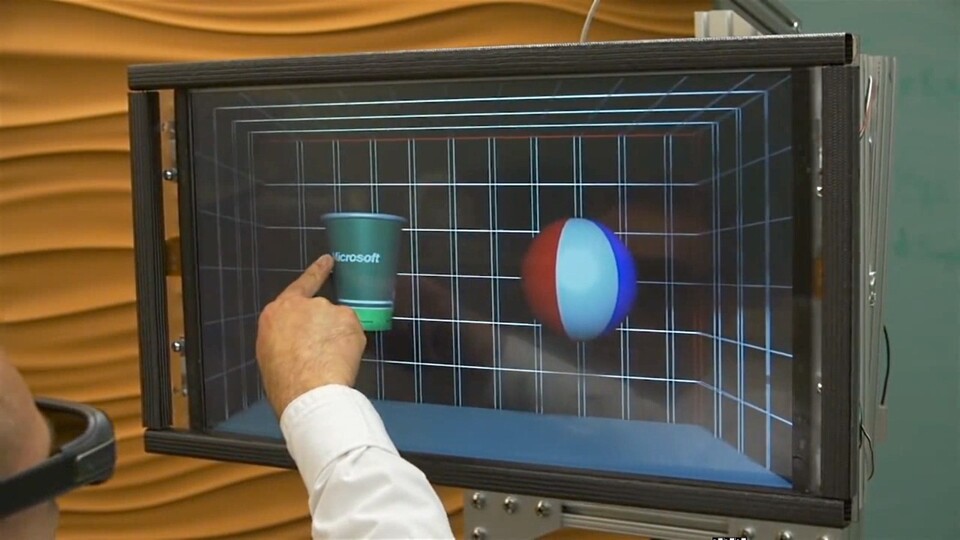

Die Forscher suchten nach einem Weg, über einen flachen Touchscreen dem Nutzer Objekteigenschaften wie Gewicht, Form oder Bewegung zu vermitteln. Dazu montierten sie einen Multitouch-3D-Monitor auf einen Robotarm, der das Display bewegen kann.

Wird nun der Monitor berührt und beispielsweise ein 3D-Objekt »nach hinten« geschoben, simuliert der Arm den Widerstand und fährt gleichzeitig das Display etwas zurück. Obwohl der Arm nur in der Lage ist, diese Bewegung durchzuführen, lassen sich so beispielsweise die Unterschiede zwischen einem Becher und einem Ball spüren, da sich der Widerstand des Arms durch die Form ändert, an der der Finger entlangfährt.

Zusammen mit der optischen 3D-Wahrnehmung reicht das dem Gehirn laut dem Forscher Michel Pahud bereits aus, um das Objekt als real zu erkennen. Als zukünftige Einsatzgebiete für verbesserte Versionen, die auch die Struktur eines Objekts fühlbar machen, sieht Microsoft natürlich auch 3D-Spiele oder medizinische Anwendungen.

Link zum YouTube-Inhalt

Nur angemeldete Benutzer können kommentieren und bewerten.

Dein Kommentar wurde nicht gespeichert. Dies kann folgende Ursachen haben:

1. Der Kommentar ist länger als 4000 Zeichen.

2. Du hast versucht, einen Kommentar innerhalb der 10-Sekunden-Schreibsperre zu senden.

3. Dein Kommentar wurde als Spam identifiziert. Bitte beachte unsere Richtlinien zum Erstellen von Kommentaren.

4. Du verfügst nicht über die nötigen Schreibrechte bzw. wurdest gebannt.

Bei Fragen oder Problemen nutze bitte das Kontakt-Formular.

Nur angemeldete Benutzer können kommentieren und bewerten.

Nur angemeldete Plus-Mitglieder können Plus-Inhalte kommentieren und bewerten.